La condizione di base dell'immagine elettronica è che l'energia luminosa viene convertita in elettricità in un modo che preserva le informazioni visivi, ci consente di ricostruire le proprietà ottiche di una scena. Questa interazione affidabile tra fotoni ed elettroni avvia il processo di acquisizione di immagini digitali. Dopo che l'energia fornita dai fotoni di incidente viene convertita in energia elettrica, il sistema deve avere un modo per misurare questa energia e conservarlo come una sequenza (o matrice) di valori.

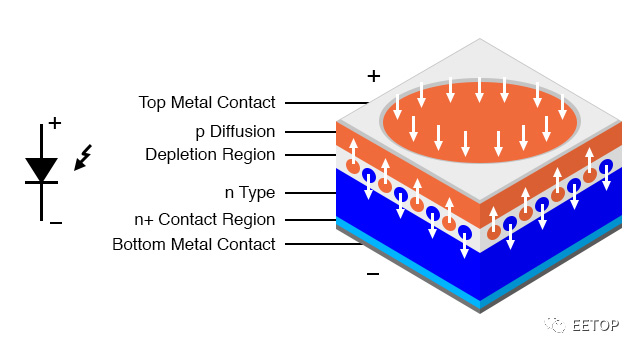

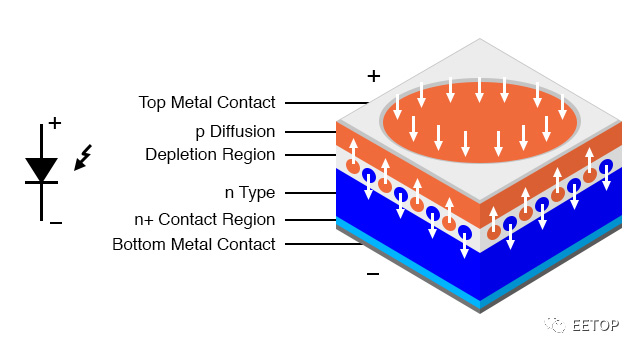

Nella maggior parte dei sensori di immagine, la conversione dalla luce all'elettricità viene fatta da un fotodiodo, che è una giunzione PN la cui struttura favorisce la generazione di coppie di fori elettronici In risposta alla luce incidente.

I fotodiodi sono di solito realizzati in silicio, ma altri materiali semiconduttori come l'arruuro di indio, l'antimonuro di indio, il tellururo di cadmio al mercurio, ecc. vengono utilizzati anche per vari scopi speciali.

Un importante anticipo nella tecnologia del sensore di immagine era la creazione di un fotodiodo di tipo bloccato. Nell'immagine sopra, un fotodiodo, come un diodo normale, è composto da una regione di tipo p e una regione di tipo n.

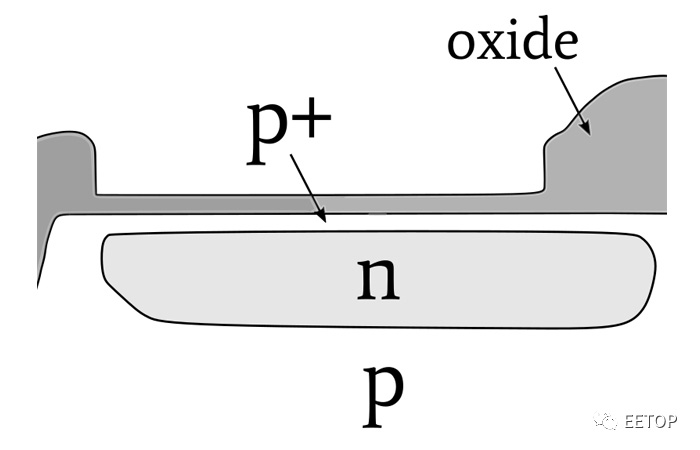

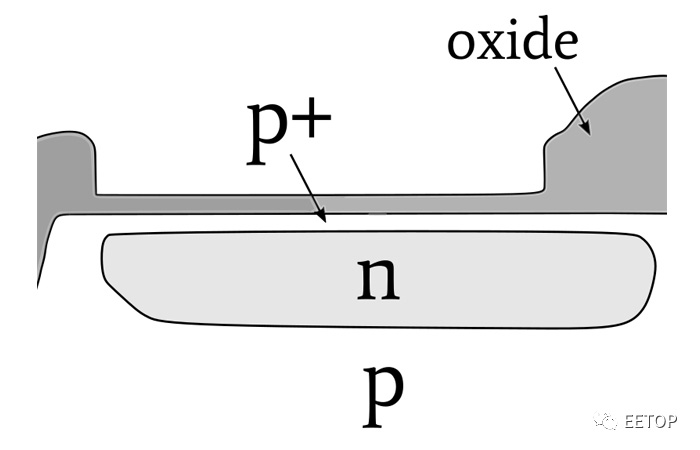

I fotodiodi di tipo appuntato hanno una regione aggiuntiva realizzata in un semiconduttore di tipo p (p per corto) altamente dopato;

Questa figura mostra la struttura di un fotodiodo appuntato integrato in un sensore di immagine

Inserito negli anni 1980, fotodiodi appuntati hanno risolto il problema (chiamato "isteresi") collegato al trasferimento ritardato della carica generata dalla luce. I fotodiodi appuntati offrono anche una maggiore efficienza quantistica, prestazioni di rumore migliorate e una corrente scura più bassa (di ritorno a questi concetti più avanti in questa serie).

Oggi l'elemento fotosensibile in quasi tutti i sensori di immagine CCD e CMOS è un fotodiodo appuntato.

Tipo di sensore di immagine

Le due principali tecnologie di imaging sono CCD (dispositivo accoppiato a carica) e CMOS.

Ci sono anche altri tipi di sensori, come sensori NMOS per spettroscopia, fotometri in miniatura che forniscono sensibilità alle immagini termiche a infrarossi e applicazioni speciali possono utilizzare array di fotodiodi collegati ai circuiti dell'amplificatore personalizzati.

In ogni caso, ci concentriamo su CCD e CMOS. Le due categorie di sensori generali coprono un'ampia gamma di applicazioni e funzioni.

Sembra che le persone siano disegnate al rapporto qualità-prezzo di "quale è meglio?" domande come montaggio superficiale o foro passante? BJT o FET? Canon o Nikon? Windows o Mac (o Linux)? Tali domande hanno di solito risposte importanti e anche il confronto delle caratteristiche individuali può essere difficile.

Quindi, quale è meglio, CMOS o CCD? Il confronto tradizionale va come questo: il CCD ha un rumore inferiore, una migliore uniformità pixel-to-pixel e ha una reputazione per una qualità dell'immagine superiore. I sensori CMOS offrono livelli più elevati di integrazione-riducendo la difficoltà per i designer di circuiti-e un basso consumo energetico.

Non dico che questa valutazione sia imprecisa, ma la sua utilità è limitata. Molto dipende dalle tue esigenze per i sensori e le tue esigenze e priorità.

La tecnologia cambia rapidamente e la grande quantità di denaro persa nella ricerca e sviluppo di immagini digitali può cambiare gradualmente il modello di CCD e CMOS.

Secondo, i sensori di immagine non producono immagini. È una parte integrale di un sistema di imaging digitale (una parte molto importante, naturalmente), e la qualità dell'immagine ricevuta prodotta dal sistema dipende non solo dal sensore, ma molti altri fattori. Non c' è nessun problema che CCDs supera i sensori CMOS per alcune proprietà optoelettroniche. Ma associazione di un CCD con un generale più altoLa qualità dell'immagine sembra un po' irragionevole.

Elementi di progettazione del sistema

Un sistema basato su sensori CCD richiede un investimento di grande design. CCDs richiede una varietà di tensioni di potenza e controllo di livello non logico (comprese le tensioni negative) e la temporizzazione che deve essere applicata al sensore può essere molto complessa. L'immagine "dati" prodotta dal sensore è una forma d'onda analogica che deve essere finemente amplificata e campionata, e, naturalmente, qualsiasi elaborazione del segnale o circuito di conversione dei dati ha il potenziale per l'introduzione del rumore.

Le prestazioni a basso rumore iniziano con un CCD, ma non finisce qui-ci deve fare attenzione a ridurre al minimo il rumore in tutta la catena del segnale.

Forma d'onda di uscita CCD

La situazione è molto diversa per i sensori di immagine CMOS. Funzionano più come circuiti integrati standard, con fonti di tensione a livello logico, elaborazione delle immagini su chip e dati di uscita digitale. Puoi anche avere a che fare con un po' di rumore di immagine aggiuntivo, ma in molte applicazioni questo è un piccolo prezzo da pagare per ridurre in modo significativo la difficoltà del design, i costi di sviluppo e lo stress.

L'elaborazione delle immagini non è una tipica attività di microcontrollore, soprattutto quando si lavora con sensori ad alta velocità di frame o ad alta risoluzione. La maggior parte delle applicazioni trarrà vantaggio dalla potenza di calcolo di un processore di segnale digitale o FPGA.

Anche la compressione deve essere presa in conto, soprattutto se è necessario conservare le immagini in memoria o trasferle in modalità wireless. Questo può essere utilizzato da software o hardware programmabile.

English

English 日本語

日本語 한국어

한국어 français

français Deutsch

Deutsch Español

Español italiano

italiano русский

русский português

português العربية

العربية tiếng việt

tiếng việt ไทย

ไทย čeština

čeština dansk

dansk Svenska

Svenska